Cette semaine, Codergo était à Paris, invité par Google en qualité de GDE (Google Developer Expert – spécialité Google Workspace) pour participer à une session de 3 jours. Je remercie au passage Google de m’avoir invité et de m’avoir permis d’assister à cette série d’évènements. Ceci est la deuxième journée.

L’évènement était clairement adressé à un public francophone, et dédié à l’IA sous toutes ses formes. Et il avait lieu au Grand Rex, à Paris!

Nous avons eu une série de conférences sur l’avenir de l’IA et ses nouveautés, mais aussi des conférences sur des problématiques plus “communes” telles que l’utilisation de Cloud Run, de stratégies de gestion de la donnée. Et surtout, il y avait une série d’ateliers de mise en pratique !

Etant expert du no-code mais ayant des connaissances de programmation solides sur Apps Script, j’ai appris des choses et ça m’a donné envie de me mettre au Python et au Golang !

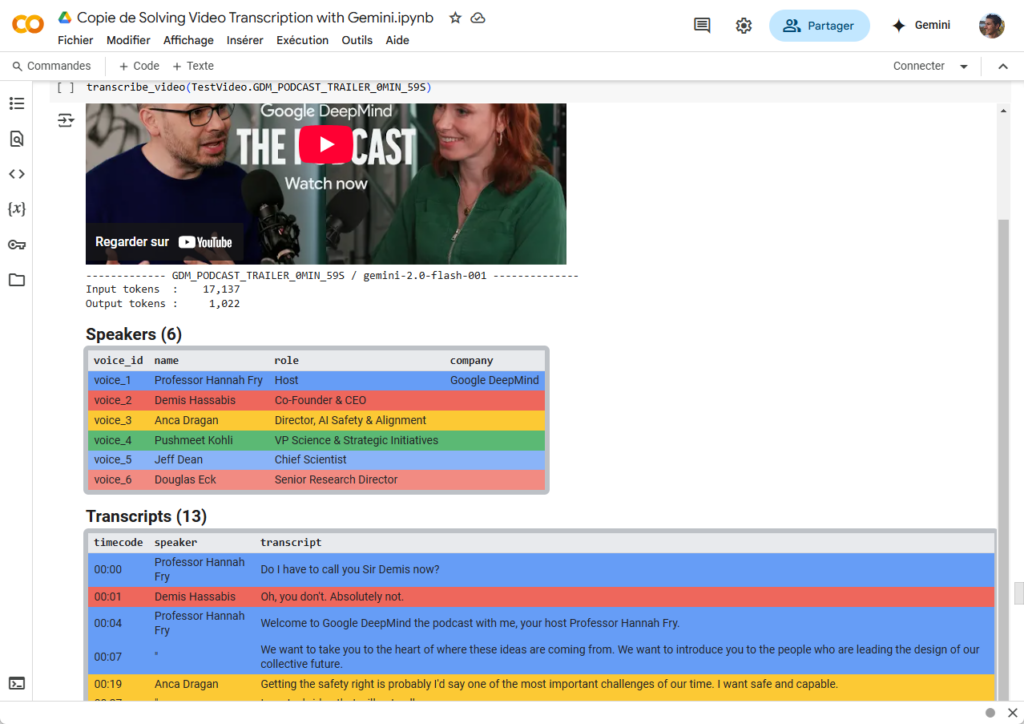

Côté pratique, j’ai découvert ce qu’était l’outil Google Colab : un environnement de développement collaboratif basé sur le Cloud, comparable à un espace de travail GitHub.

Les ateliers

J’ai pu participer à deux ateliers « hands-on labs ».

- “LLM & Gemini : multimodalité et long contexte”, avec Laurent Picard. Absolument génial, il nous a montré comment utiliser Gemini pour obtenir la transcription d’une vidéo avec une technique économe en tokens.

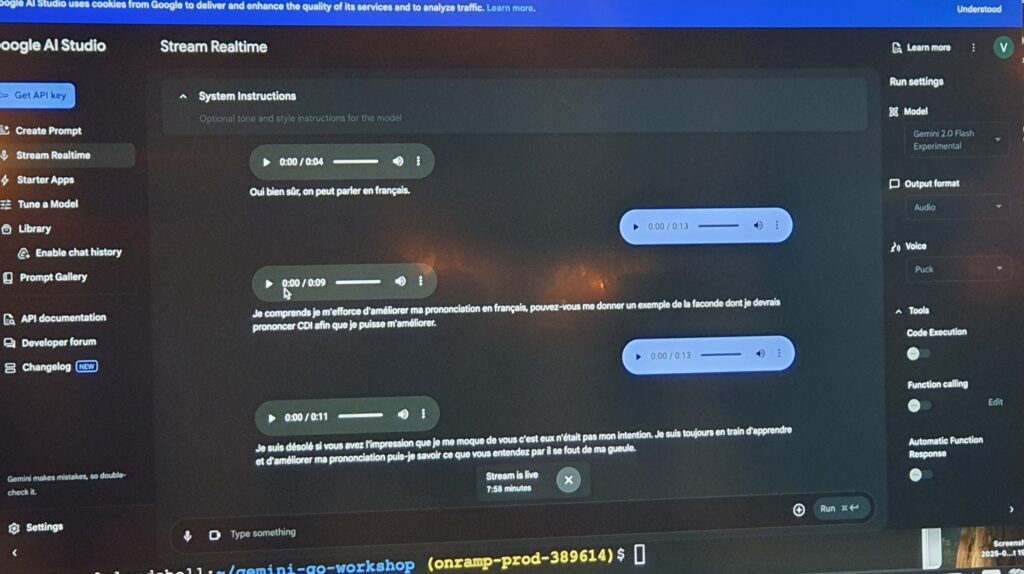

- “Gemini 2.0 pour le développeur Go”, avec Vincent Deleplace et Julien Breux, qui nous ont montré comment utiliser un modèle en commande console depuis Google Cloud, pour analyser des images, une vidéo, et même un flux vidéo avec partage d’écran et de vidéo ! Nec plus ultra, nous avons testé en live l’interaction homme-machine, où la machine s’est “vexé” d’un commentaire qui nous était adressé (rappelons qu’elle n’a pas de sentiment !)

Une conférence marquante : Imagen-3

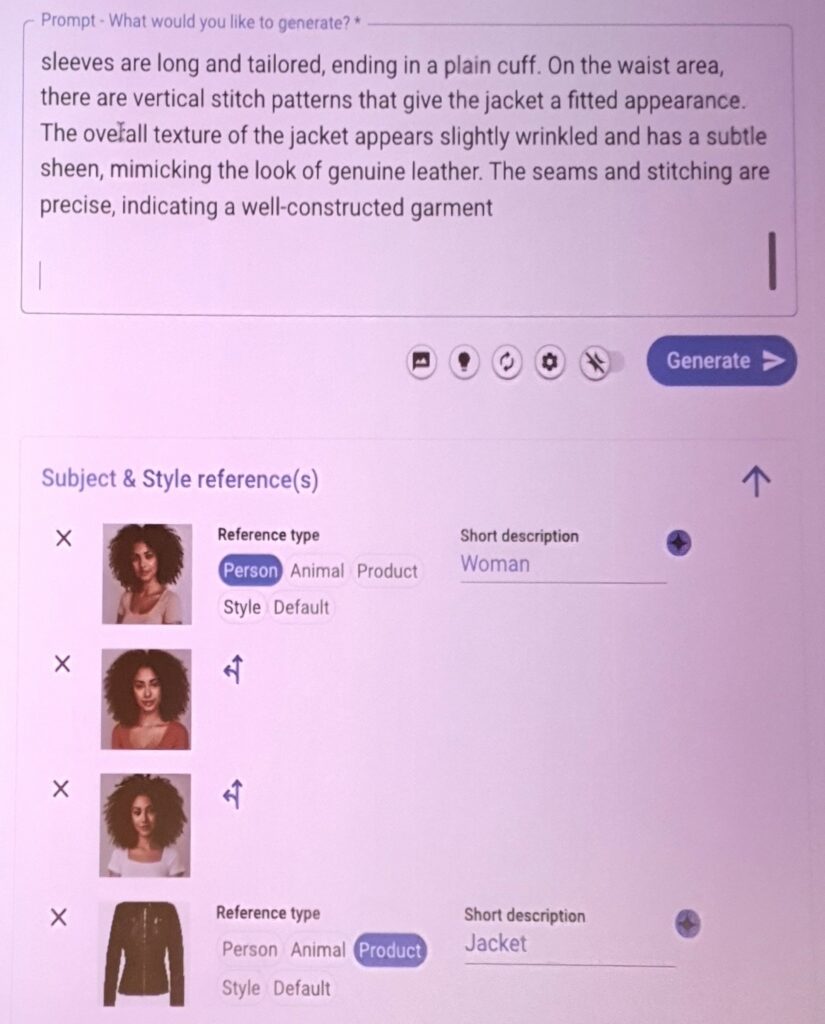

Je n’ai pas pu assister à toutes les conférences, le programme était chargé. Parmi les conférences qui m’ont marqué, il y a eu une démonstration de Imagen-3 avec Agathe Duboué.

L’outil permet de :

- générer des image

- les modifier à volonté

- fournir des images de références pour le résultat attendu

- préciser les attributs de l’image

Il est à noter qu’à chaque génération de départ, tous les pixels sont régénérés et donc il y a autant de tokens consommés à la lecture du prompt. En revanche, sur une modification, seule la partie modifiée est régénérée, le reste est préservé..

En termes de paramètres d’entrée :

- on peut fournir jusqu’à 4 images de référence, et préciser si ce sont des personnes, des animaux, des produits, ou un style d’image, tout en ajoutant une description (“jacket” pour une photo de veste par exemple)

- parmi les images proposées, on peut modifier au choix une zone précise en enlevant ou ajoutant des éléments, en précisant si c’est au premier plan ou à l’arrière-plan, etc

- enfin, on peut choisir le format de l’image, sa résolution, la position des éléments dans le cadre, le type de fichier, etc

- on peut même préciser ce qu’on ne souhaite pas voir dans l’image : le terme est “negative prompt”. Ce peut être de la mousse sur une photo d’un toit en tuile par exemple.

- on peut enfin indiquer la “découvrabilité” de l’image si elle a vocation à faire partie d’une banque d’images en interne par exemple. C’est une série de tags, telles que l’équipe de création, le type de plateforme pour lequel l’image est destinée, une marque, etc.

Voici un exemple de rendu:

Bref, vous l’avez compris, c’est un outil très puissant et polyvalent !

Pour illustrer un cas concret, Agathe nous a cité le cas d’une agence de communication/marketing qui prépare un brief avec une idée assez précise pour un vêtement ou un accessoire, et le donne ensuite à son équipe créa pour réaliser le “vrai” shooting ensuite.

La clôture

La journée de conférences s’est soldée par une intervention d’un doctorant de chez Airbus, qui nous a montré comment faire des avions en papier à l’aide de l’IA. Il y avait des notions de portance, de trainée, de poussée, de stabilité, de “becs de canard”, d’ailerons… C’était drôle, ludique et passionnant ! Pour la culture générale, le record de distance est de 88m depuis 2022.

Et enfin, puisque nous étions tout de même au Grand Rex, le film Matrix (le premier) a été projeté !